Kontrolin ang mga Robot nang Malayo gamit ang Apple Vision Pro, NVIDIA: 'Hindi Mahirap ang Pagsasama ng Tao at Makina'

Sinabi ni Jensen Huang, "Ang susunod na alon ng AI ay mga robot, at isa sa mga pinaka-kapana-panabik na pag-unlad ay ang mga humanoid robot." Ngayon, ang Project GR00T ay gumawa ng mahalagang hakbang pasulong.

Kahapon, tinalakay ng tagapagtatag ng NVIDIA na si Jensen Huang ang kanilang modelo ng humanoid robot na pangkalahatan, "Project GR00T," sa kanyang pangunahing talumpati sa SIGGRAPH 2024. Ang modelo ay nakatanggap ng isang serye ng mga functional updates.

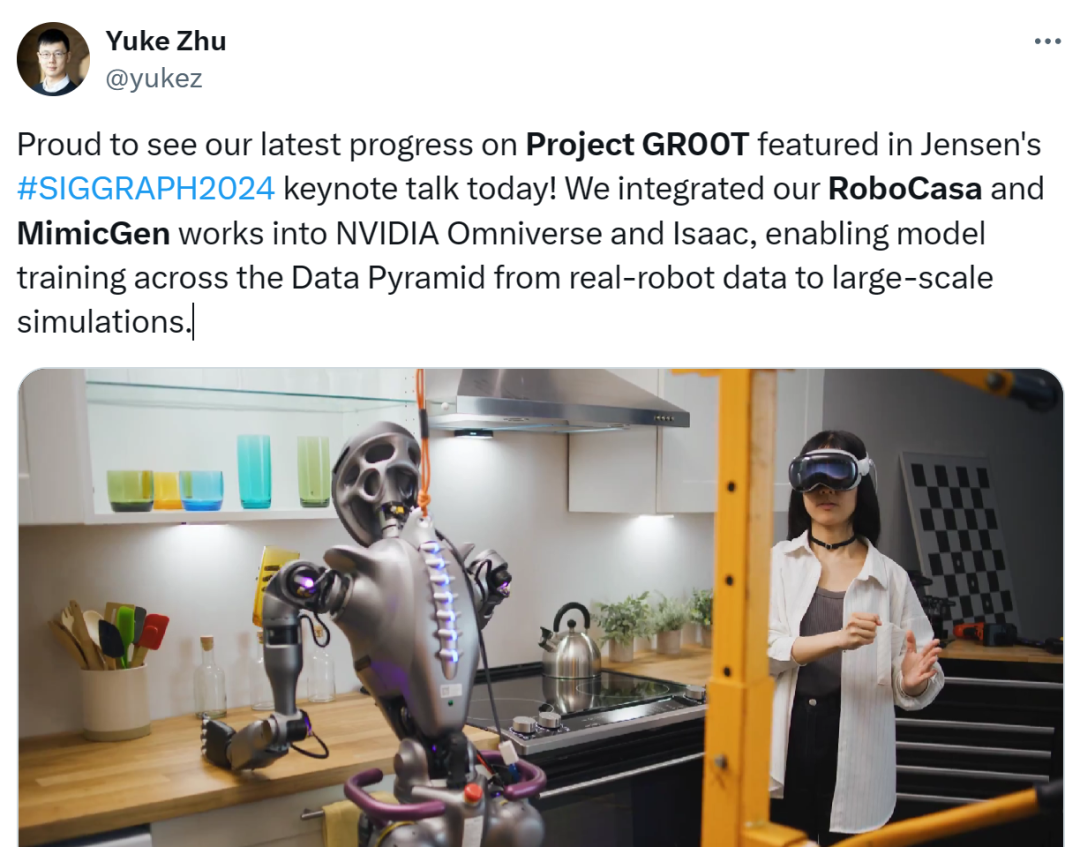

Si Yuke Zhu, isang assistant professor sa University of Texas sa Austin at isang senior research scientist sa NVIDIA, nag-tweet ng isang video na nagpapakita kung paano isinama ng NVIDIA ang malakihang simulation training frameworks na RoboCasa at MimicGen sa NVIDIA Omniverse platform at ang Isaac robot development platform.

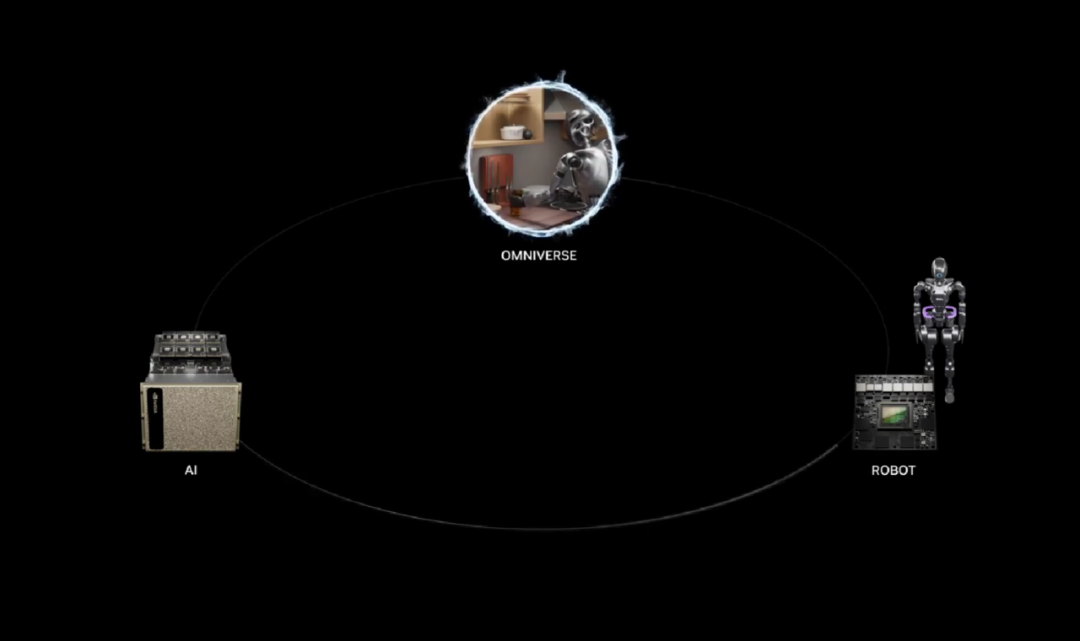

Sinasaklaw ng video ang tatlong computing platforms ng NVIDIA—AI, Omniverse, at Jetson Thor—na ginagamit upang pasimplehin at pabilisin ang mga workflow ng developer. Sa pamamagitan ng pinagsamang kakayahan ng mga computing platforms na ito, tayo ay nasa landas patungo sa isang panahon ng mga humanoid robot na pinapagana ng physical AI.

Isa sa mga pangunahing tampok ay maaaring gamitin ng mga developer ang Apple Vision Pro upang kontrolin ang mga humanoid robot mula sa malayo upang magsagawa ng mga gawain.

Samantala, sinabi ng isa pang senior research scientist sa NVIDIA, si Jim Fan, na ang mga update sa Project GR00T ay kapana-panabik. Gumagamit ang NVIDIA ng sistematikong diskarte upang sukatin ang data ng robot, tinutugunan ang ilan sa mga pinaka-mapanghamong problema sa larangan ng robotics.

Ang ideya ay simple: ang mga tao ay kumokolekta ng demonstration data sa mga totoong robot, at ang NVIDIA ay nagsusukat ng data na ito ng isang libong beses o higit pa sa mga simulation. Sa GPU-accelerated simulations, maaari na ngayong gamitin ng mga tao ang computational power upang palitan ang nakakaubos ng oras, labor-intensive, at magastos na proseso ng pagkolekta ng data mula sa tao.

Binanggit niya na hindi matagal na ang nakalipas, naniniwala siyang ang remote operation ay fundamentally unscalable dahil, sa atomic world, palagi tayong nasasakal ng limitasyon ng 24 oras bawat robot bawat araw. Ang bagong synthetic data pipeline na ginamit sa GR00T ay bumabasag sa limitasyong ito sa digital world.

Tungkol sa pinakabagong mga pag-unlad ng NVIDIA sa humanoid robotics, isang netizen ang nagkomento na natagpuan ng Apple Vision Pro ang pinaka-cool na gamit nito.

Nagsisimula ang NVIDIA na manguna sa susunod na alon: physical AI.

Detalyado rin ng NVIDIA ang teknikal na proseso ng pagpapabilis ng humanoid robots sa isang blog post. Narito ang buong nilalaman:

Upang pabilisin ang pag-unlad ng humanoid robots sa buong mundo, inihayag ng NVIDIA ang isang set ng mga serbisyo, modelo, at computing platforms para sa mga nangungunang tagagawa ng robot, mga developer ng AI model, at mga software makers sa buong mundo, na nagpapahintulot sa kanila na bumuo, sanayin, at lumikha ng susunod na henerasyon ng mga humanoid robot.

Kasama sa suite na ito ang bagong NVIDIA NIM microservices at frameworks para sa simulation at pag-aaral ng robot, ang NVIDIA OSMO orchestration service para sa pagpapatakbo ng multi-stage robot workloads, at ang remote operation workflow na sumusuporta sa AI at simulation, na nagpapahintulot sa mga developer na sanayin ang mga robot na may minimal na human demonstration data.

Sinabi ni Jensen Huang, "Ang susunod na alon ng AI ay mga robot, at isa sa mga pinaka-kapana-panabik na pag-unlad ay ang mga humanoid robot. Pinapabilis namin ang buong stack ng robot ng NVIDIA, binubuksan ito para sa mga developer ng humanoid robot at mga kumpanya sa buong mundo, na nagpapahintulot sa kanila na gamitin ang mga platform, pinabilis na mga library, at mga AI model na pinakamainam para sa kanilang mga pangangailangan."

Pabilisin ang pag-unlad gamit ang NVIDIA NIM at OSMO.

Ang NIM microservices ay nag-aalok ng pre-built containers na pinapagana ng NVIDIA inference software, na nagpapababa ng oras ng deployment mula sa mga linggo hanggang sa mga minuto.

Dalawang bagong AI microservices ang magbibigay-daan sa mga eksperto sa robotics na mapabuti ang henerasyon ng physical AI simulation workflows sa NVIDIA Isaac Sim.

Ang MimicGen NIM microservice ay bumubuo ng synthetic motion data mula sa remotely recorded data mula sa spatial computing devices tulad ng Apple Vision Pro. Ang Robocasa NIM microservice ay bumubuo ng mga gawain ng robot at simulation environments sa OpenUSD.

Ang cloud-native managed service na NVIDIA OSMO ay ngayon ay available, na nagpapahintulot sa mga user na i-coordinate at sukatin ang kumplikadong robot development workflows sa mga distributed computing resources, maging ito ay on-premises o sa cloud. Ang OSMO ay makabuluhang nagpapasimple ng robot training at simulation workflows, na nagpapababa ng deployment at development cycles mula sa mga buwan hanggang sa ilalim ng isang linggo.

Nagbibigay ng advanced data capture workflows para sa mga developer ng humanoid robot.

Ang pagsasanay sa mga foundational models sa likod ng mga humanoid robot ay nangangailangan ng napakalaking dami ng data. Isang paraan upang makuha ang human demonstration data ay sa pamamagitan ng remote operation, ngunit ang paraang ito ay nagiging lalong mahal at matagal.

Sa pamamagitan ng pagpapakita ng NVIDIA AI at Omniverse remote operation reference workflow sa SIGGRAPH computer graphics conference, ang mga mananaliksik at AI developer ay makakabuo ng malaking halaga ng synthetic motion at perception data mula sa minimal na halaga ng remotely captured human demonstrations.

Una, kinokolekta ng mga developer ang kaunting remote demonstration gamit ang Apple Vision Pro. Pagkatapos, isinasagawa nila ang mga simulation recordings sa NVIDIA Isaac Sim at ginagamit ang MimicGen NIM microservice upang bumuo ng synthetic datasets mula sa mga recordings.

Ginagamit ng mga developer ang parehong real at synthetic data upang sanayin ang Project GR00T humanoid robot foundational model, na nakakatipid ng malaking oras at nagbabawas ng mga gastos. Pagkatapos ay ginagamit nila ang Robocasa NIM microservice sa Isaac Lab, isang robot learning framework, upang bumuo ng mga karanasan para sa retraining ng robot model. Sa buong workflow, walang putol na inaallocate ng NVIDIA OSMO ang mga computing tasks sa iba't ibang resources, na nagpapababa ng workload ng pamamahala ng mga developer ng mga linggo.

Pinalawak ang access sa mga teknolohiya ng developer ng humanoid robot ng NVIDIA.

Nag-aalok ang NVIDIA ng tatlong computing platforms upang pasimplehin ang pagbuo ng humanoid robot: ang NVIDIA AI supercomputer para sa pagsasanay ng mga modelo; ang NVIDIA Isaac Sim, na itinayo sa Omniverse, para sa mga robot na matuto at pinuhin ang mga kasanayan sa isang simulated world; at ang NVIDIA Jetson Thor humanoid robot computer para sa pagpapatakbo ng mga modelo. Maaaring ma-access at magamit ng mga developer ang lahat o bahagi ng mga platform na ito ayon sa kanilang mga partikular na pangangailangan.

Sa pamamagitan ng bagong NVIDIA Humanoid Robot Developer Program, ang mga developer ay makakakuha ng maagang access sa mga bagong produkto at ang pinakabagong bersyon ng NVIDIA Isaac Sim, NVIDIA Isaac Lab, Jetson Thor, at ang Project GR00T general humanoid robot foundational model.

Ang 1x, Boston Dynamics, ByteDance, Field AI, Figure, Fourier, Galbot, LimX Dynamics, Mentee, Neura Robotics, RobotEra, at Skild AI ay kabilang sa mga unang kumpanya na sumali sa early access program.

Maaaring sumali ang mga developer ngayon sa NVIDIA Humanoid Robot Developer Program upang ma-access ang NVIDIA OSMO at Isaac Lab at sa lalong madaling panahon ay makakuha ng access sa NVIDIA NIM microservices.

Link ng blog: https://nvidianews.nvidia.com/news/nvidia-accelerates-worldwide-humanoid-robotics-development

Sundan ang WriteGo upang makuha ang pinakabagong impormasyon tungkol sa AI