Controlla i Robot a Distanza con Apple Vision Pro, NVIDIA: 'L'Integrazione Uomo-Macchina Non è Difficile'

Jensen Huang ha dichiarato: "La prossima ondata di IA sono i robot e uno degli sviluppi più entusiasmanti sono i robot umanoidi." Oggi, il Project GR00T ha compiuto un passo importante in avanti.

Ieri, il fondatore di NVIDIA, Jensen Huang, ha parlato del loro modello di robot umanoide a uso generale, "Project GR00T", durante il suo discorso principale a SIGGRAPH 2024. Il modello ha ricevuto una serie di aggiornamenti funzionali.

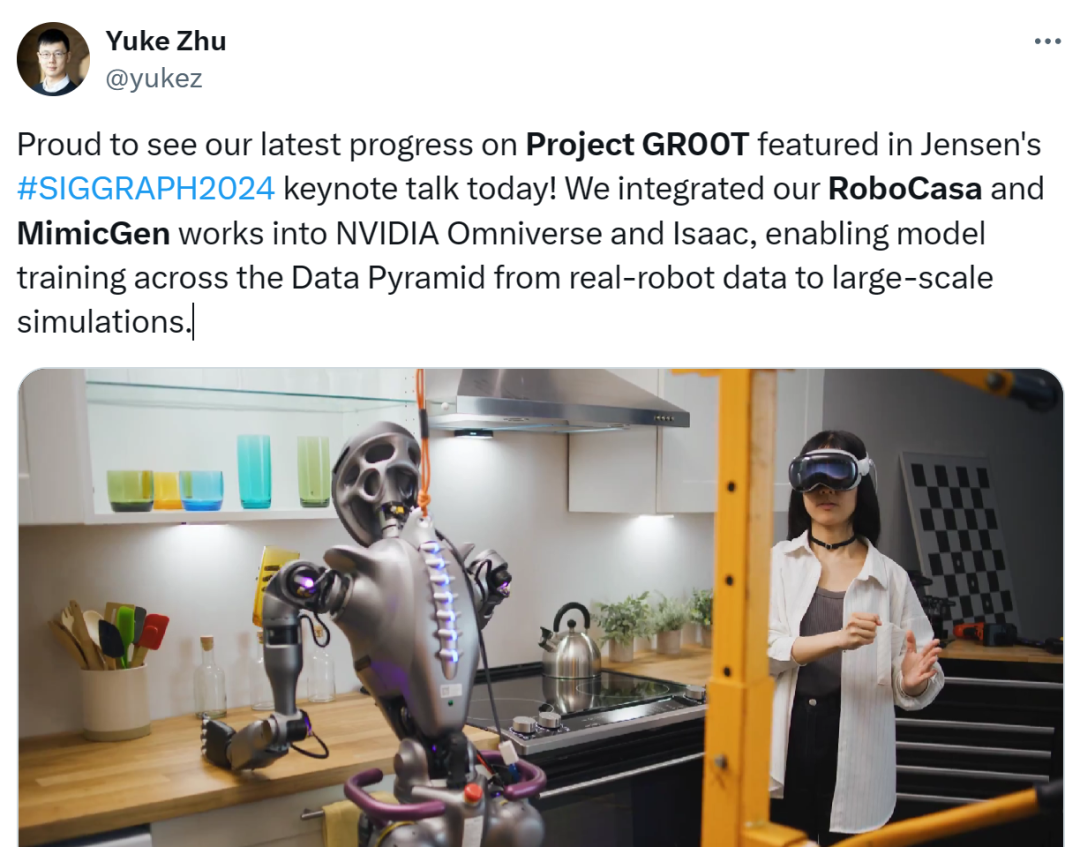

Yuke Zhu, assistente professore presso l'Università del Texas ad Austin e ricercatore senior presso NVIDIA, ha twittato un video che dimostra come NVIDIA abbia integrato i framework di simulazione di robot domestici su larga scala RoboCasa e MimicGen nella piattaforma NVIDIA Omniverse e nella piattaforma di sviluppo robotico Isaac.

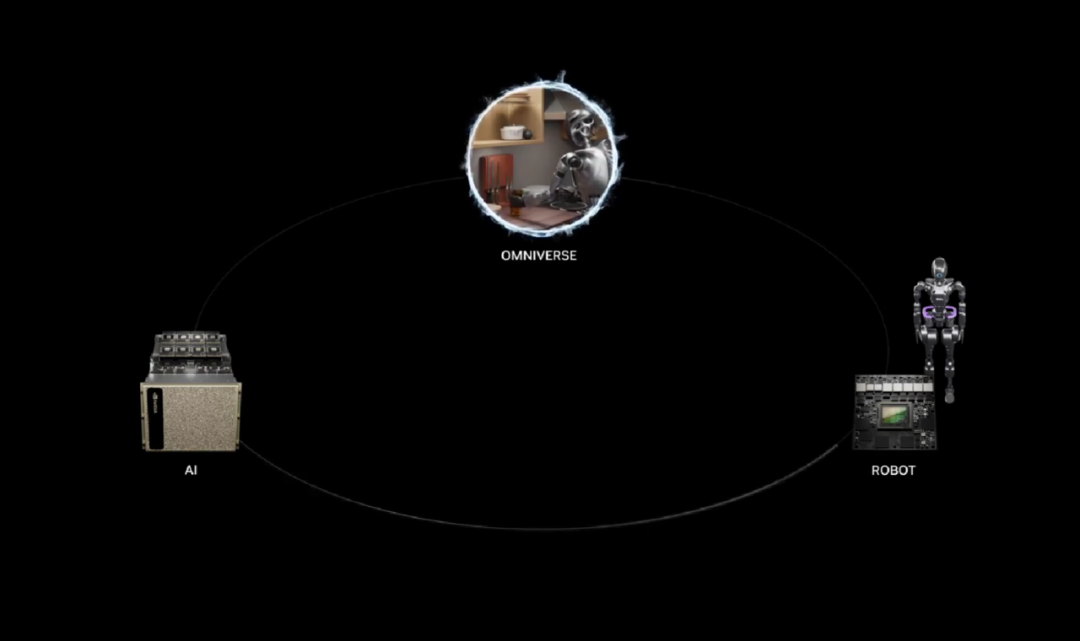

Il video copre le tre piattaforme di calcolo di NVIDIA—IA, Omniverse e Jetson Thor—sfruttandole per semplificare e accelerare i flussi di lavoro degli sviluppatori. Grazie alle capacità combinate di queste piattaforme di calcolo, siamo pronti ad entrare in un'era di robot umanoidi guidati da IA fisica.

Tra i punti salienti c'è che gli sviluppatori possono utilizzare Apple Vision Pro per controllare a distanza i robot umanoidi e farli eseguire compiti.

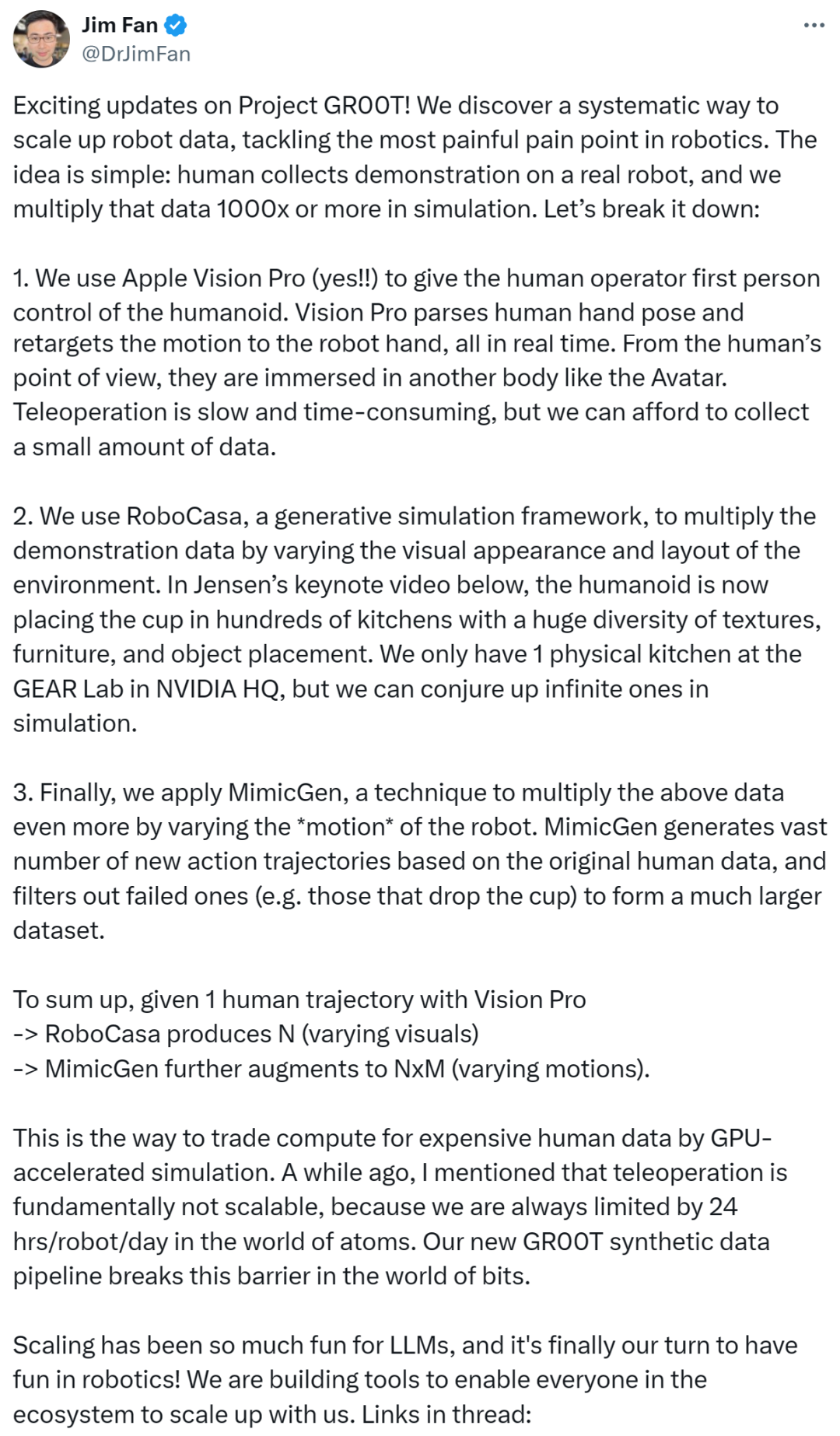

Nel frattempo, un altro ricercatore senior di NVIDIA, Jim Fan, ha affermato che gli aggiornamenti al Project GR00T sono esaltanti. NVIDIA utilizza un approccio sistematico per scalare i dati dei robot, affrontando alcuni dei problemi più complessi nel campo della robotica.

L'idea è semplice: gli esseri umani raccolgono dati di dimostrazione su robot reali, e NVIDIA scala questi dati mille volte o più nelle simulazioni. Con simulazioni accelerate da GPU, le persone possono ora utilizzare la potenza computazionale per sostituire il processo di raccolta dati umani, che è dispendioso in termini di tempo, lavoro e costi.

Ha menzionato che non molto tempo fa credeva che l'operazione remota fosse fondamentalmente non scalabile perché, nel mondo atomico, siamo sempre vincolati dal limite di 24 ore per robot al giorno. Il nuovo pipeline di dati sintetici utilizzato in GR00T rompe questo limite nel mondo digitale.

Riguardo agli ultimi progressi di NVIDIA nella robotica umanoide, un utente della rete ha commentato che Apple Vision Pro ha trovato il suo utilizzo più interessante.

NVIDIA inizia a guidare la prossima ondata: IA fisica.

NVIDIA ha anche dettagliato il processo tecnico per accelerare i robot umanoidi in un post sul blog. Ecco il contenuto completo:

Per accelerare lo sviluppo di robot umanoidi in tutto il mondo, NVIDIA ha annunciato una serie di servizi, modelli e piattaforme di calcolo per i principali produttori di robot, sviluppatori di modelli IA e produttori di software a livello globale, consentendo loro di sviluppare, addestrare e costruire la prossima generazione di robot umanoidi.

Questo pacchetto include i nuovi microservizi e framework NVIDIA NIM per la simulazione e l'apprendimento dei robot, il servizio di orchestrazione NVIDIA OSMO per eseguire carichi di lavoro robotici multi-stadio, e il flusso di lavoro di operazione remota che supporta IA e simulazione, consentendo agli sviluppatori di addestrare i robot con dati di dimostrazione umana minimi.

Jensen Huang ha dichiarato: "La prossima ondata di IA sono i robot, e uno degli sviluppi più entusiasmanti sono i robot umanoidi. Stiamo avanzando nell'intero stack robotico NVIDIA, aprendolo a sviluppatori e aziende di robot umanoidi in tutto il mondo, consentendo loro di utilizzare le piattaforme, le librerie accelerate e i modelli IA che meglio soddisfano le loro esigenze."

Accelerare lo sviluppo con NVIDIA NIM e OSMO.

I microservizi NIM offrono contenitori pre-costruiti alimentati dal software di inferenza NVIDIA, riducendo il tempo di distribuzione da settimane a minuti.

Due nuovi microservizi IA consentiranno agli esperti di robotica di migliorare la generazione di flussi di lavoro di simulazione IA fisica in NVIDIA Isaac Sim.

Il microservizio MimicGen NIM genera dati di movimento sintetici da dati registrati a distanza da dispositivi di calcolo spaziale come Apple Vision Pro. Il microservizio Robocasa NIM genera compiti per i robot e ambienti di simulazione in OpenUSD.

Il servizio gestito cloud-native NVIDIA OSMO è ora disponibile, consentendo agli utenti di coordinare e scalare flussi di lavoro di sviluppo robotico complessi su risorse di calcolo distribuite, sia in loco che nel cloud. OSMO semplifica notevolmente i flussi di lavoro di addestramento e simulazione dei robot, riducendo i cicli di distribuzione e sviluppo da mesi a meno di una settimana.

Fornire flussi di lavoro avanzati per la cattura dei dati per gli sviluppatori di robot umanoidi.

Addestrare i modelli fondamentali dietro i robot umanoidi richiede enormi quantità di dati. Un modo per ottenere dati di dimostrazione umana è attraverso l'operazione remota, ma questo metodo sta diventando sempre più costoso e dispendioso in termini di tempo.

Mostrando il flusso di lavoro di riferimento per l'operazione remota NVIDIA AI e Omniverse alla conferenza di grafica computerizzata SIGGRAPH, i ricercatori e gli sviluppatori di IA possono generare grandi quantità di dati di movimento e percezione sintetici da una quantità minima di dimostrazioni umane catturate a distanza.

Per prima cosa, gli sviluppatori catturano una piccola quantità di dimostrazione remota utilizzando Apple Vision Pro. Poi, simulano le registrazioni in NVIDIA Isaac Sim e utilizzano il microservizio MimicGen NIM per generare set di dati sintetici dalle registrazioni.

Gli sviluppatori utilizzano dati sia reali che sintetici per addestrare il modello fondamentale del robot umanoide Project GR00T, risparmiando tempo e riducendo i costi. Usano poi il microservizio Robocasa NIM in Isaac Lab, un framework di apprendimento per robot, per generare esperienze per riaddestrare il modello del robot. Durante tutto il flusso di lavoro, NVIDIA OSMO assegna senza soluzione di continuità i compiti di calcolo a diverse risorse, riducendo il carico di lavoro di gestione degli sviluppatori di settimane.

Espandere l'accesso alle tecnologie di sviluppo di robot umanoidi di NVIDIA.

NVIDIA offre tre piattaforme di calcolo per semplificare lo sviluppo di robot umanoidi: il supercomputer IA NVIDIA per l'addestramento dei modelli; NVIDIA Isaac Sim, costruito su Omniverse, per i robot per apprendere e perfezionare le abilità in un mondo simulato; e il computer per robot umanoidi NVIDIA Jetson Thor per eseguire modelli. Gli sviluppatori possono accedere e utilizzare tutte o parte di queste piattaforme in base alle loro esigenze specifiche.

Attraverso il nuovo Programma di Sviluppo Robotico Umanoide di NVIDIA, gli sviluppatori possono avere accesso anticipato a nuovi prodotti e alle ultime versioni di NVIDIA Isaac Sim, NVIDIA Isaac Lab, Jetson Thor e il modello fondamentale generale per robot umanoidi Project GR00T.

1x, Boston Dynamics, ByteDance, Field AI, Figure, Fourier, Galbot, LimX Dynamics, Mentee, Neura Robotics, RobotEra e Skild AI sono tra le prime aziende a unirsi al programma di accesso anticipato.

Gli sviluppatori possono ora unirsi al Programma di Sviluppo Robotico Umanoide di NVIDIA per accedere a NVIDIA OSMO e Isaac Lab e presto guadagnare accesso ai microservizi NVIDIA NIM.

Link al blog: https://nvidianews.nvidia.com/news/nvidia-accelerates-worldwide-humanoid-robotics-development

Segui WriteGo per ricevere le ultime informazioni sull'IA

Share this article

Related Posts

p>La nuova tendenza della scrittura AI sta davvero rivoluzionando il nostro approccio alle attività di scrittura, rendendo il processo significativamente più facile ed efficiente. Con strumenti come il AI Essay Writer di WriteGo, le persone possono sfruttare il potere dell'intelligenza artificiale per creare saggi, articoli di ricerca e articoli di alta qualità con il minimo sforzo. Questa innovazione non riguarda solo la semplificazione del processo di scrittura; si tratta di migliorare la qual

der_faab3 auto-hide-last-sibling-br">Introduzione: La Rivoluzione della Scrittura AI