Steuern Sie Roboter aus der Ferne mit Apple Vision Pro, NVIDIA: 'Mensch-Maschine-Integration ist nicht schwierig'

Jensen Huang sagte: "Die nächste Welle der KI sind Roboter, und eine der aufregendsten Entwicklungen sind humanoide Roboter." Heute hat Projekt GR00T einen wichtigen Schritt nach vorne gemacht.

Gestern sprach NVIDIA-Gründer Jensen Huang während seiner Keynote auf der SIGGRAPH 2024 über ihr allgemeines humanoides Roboter-Modell, "Projekt GR00T", das eine Reihe von funktionalen Updates erhalten hat.

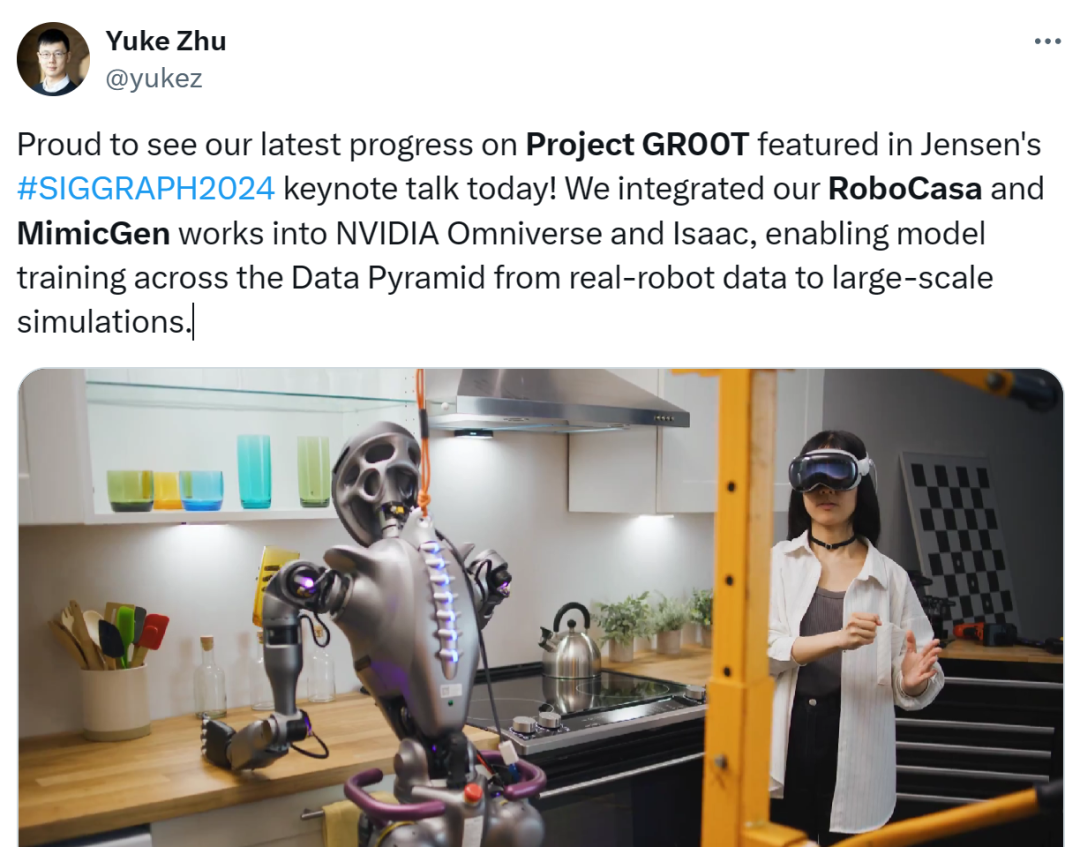

Yuke Zhu, Assistenzprofessor an der University of Texas at Austin und leitender Forschungswissenschaftler bei NVIDIA, tweetete ein Video, das zeigt, wie NVIDIA die großangelegten Trainingsrahmen für Haushaltsrobotersimulationen, RoboCasa und MimicGen, in die NVIDIA Omniverse-Plattform und die Isaac-Roboterentwicklungsplattform integriert hat.

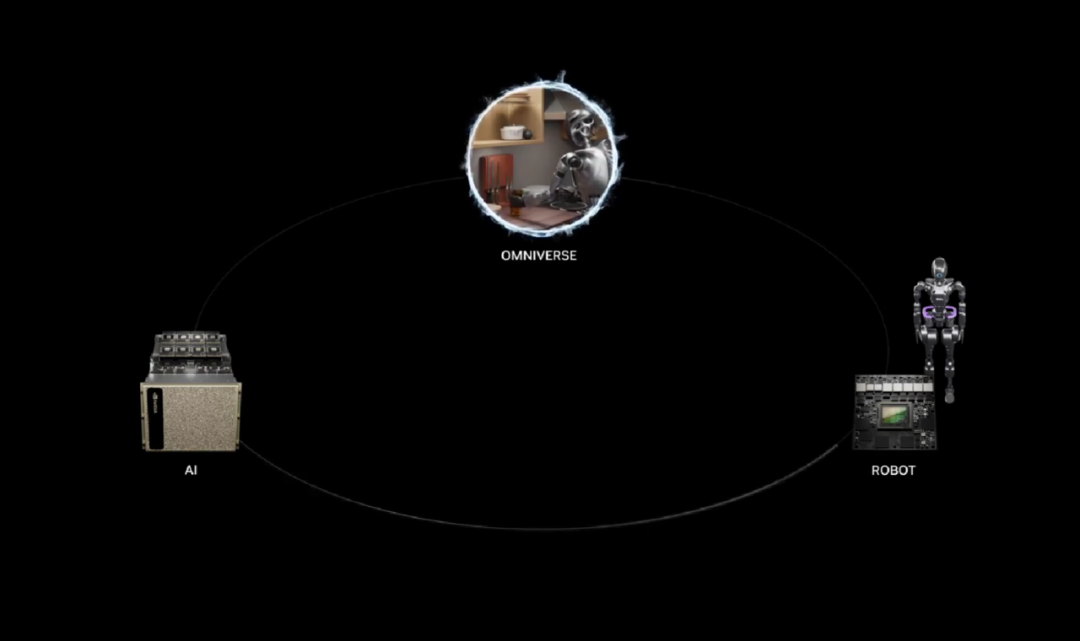

Das Video behandelt die drei Rechenplattformen von NVIDIA – KI, Omniverse und Jetson Thor – und nutzt sie, um die Arbeitsabläufe der Entwickler zu vereinfachen und zu beschleunigen. Durch die kombinierten Fähigkeiten dieser Rechenplattformen stehen wir am Beginn einer Ära humanoider Roboter, die von physischer KI angetrieben werden.

Zu den Höhepunkten gehört, dass Entwickler Apple Vision Pro verwenden können, um humanoide Roboter aus der Ferne zu steuern und Aufgaben auszuführen.

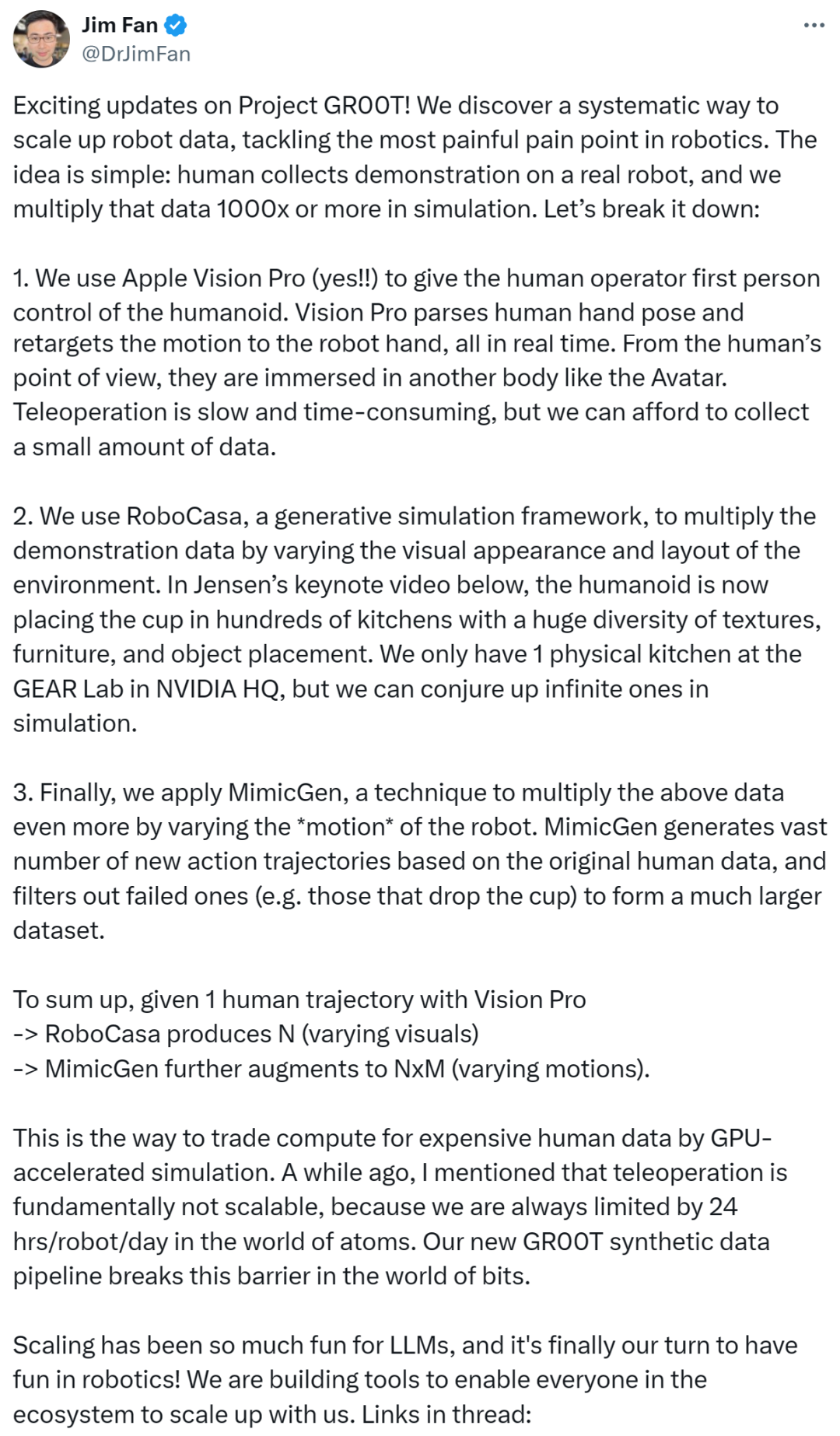

In der Zwischenzeit erklärte ein weiterer leitender Forschungswissenschaftler bei NVIDIA, Jim Fan, dass die Updates für Projekt GR00T aufregend sind. NVIDIA verwendet einen systematischen Ansatz, um Roboter-Daten zu skalieren und einige der herausforderndsten Probleme im Bereich der Robotik anzugehen.

Die Idee ist einfach: Menschen sammeln Demonstrationsdaten auf echten Robotern, und NVIDIA skaliert diese Daten tausendfach oder mehr in Simulationen. Mit GPU-beschleunigten Simulationen können Menschen jetzt Rechenleistung nutzen, um den zeitaufwändigen, arbeitsintensiven und kostspieligen Prozess der menschlichen Datensammlung zu ersetzen.

Er erwähnte, dass er vor nicht allzu langer Zeit glaubte, dass Fernoperationen grundsätzlich nicht skalierbar seien, da wir in der atomaren Welt immer durch das Limit von 24 Stunden pro Roboter pro Tag eingeschränkt sind. Die neue synthetische Datenpipeline, die in GR00T verwendet wird, durchbricht diese Einschränkung in der digitalen Welt.

Bezüglich der neuesten Fortschritte von NVIDIA in der humanoiden Robotik kommentierte ein Internetnutzer, dass Apple Vision Pro seinen coolsten Anwendungsfall gefunden hat.

NVIDIA beginnt, die nächste Welle zu führen: physische KI.

NVIDIA erläuterte auch den technischen Prozess zur Beschleunigung humanoider Roboter in einem Blogbeitrag. Hier ist der vollständige Inhalt:

Um die Entwicklung humanoider Roboter weltweit zu beschleunigen, kündigte NVIDIA eine Reihe von Dienstleistungen, Modellen und Rechenplattformen für führende Roboterhersteller, KI-Modellentwickler und Softwarehersteller weltweit an, die es ihnen ermöglichen, die nächste Generation humanoider Roboter zu entwickeln, zu trainieren und zu bauen.

Dieses Paket umfasst die neuen NVIDIA NIM-Microservices und -Frameworks für Robotersimulation und -lernen, den NVIDIA OSMO-Orchestrierungsdienst für die Ausführung mehrstufiger Roboter-Workloads und den Workflow für die Fernoperation, der KI und Simulation unterstützt und es Entwicklern ermöglicht, Roboter mit minimalen menschlichen Demonstrationsdaten zu trainieren.

Jensen Huang erklärte: "Die nächste Welle der KI sind Roboter, und eine der aufregendsten Entwicklungen sind humanoide Roboter. Wir entwickeln den gesamten NVIDIA-Roboter-Stack weiter und öffnen ihn für Entwickler und Unternehmen humanoider Roboter weltweit, damit sie die Plattformen, beschleunigten Bibliotheken und KI-Modelle nutzen können, die ihren Bedürfnissen am besten entsprechen."

Entwicklung beschleunigen mit NVIDIA NIM und OSMO.

NIM-Microservices bieten vorgefertigte Container, die von NVIDIA-Inferenzsoftware unterstützt werden, und reduzieren die Bereitstellungszeit von Wochen auf Minuten.

Zwei neue KI-Microservices ermöglichen es Robotikexperten, die Generierung physischer KI-Simulations-Workflows in NVIDIA Isaac Sim zu verbessern.

Der MimicGen NIM-Microservice generiert synthetische Bewegungsdaten aus aus der Ferne aufgezeichneten Daten von räumlichen Rechen Geräten wie Apple Vision Pro. Der Robocasa NIM-Microservice generiert Roboteraufgaben und Simulationsumgebungen in OpenUSD.

Der cloud-native verwaltete Dienst NVIDIA OSMO ist jetzt verfügbar und ermöglicht es Benutzern, komplexe Roboterentwicklungs-Workflows über verteilte Rechenressourcen zu koordinieren und zu skalieren, egal ob vor Ort oder in der Cloud. OSMO vereinfacht die Robotertrainings- und Simulations-Workflows erheblich und verkürzt die Bereitstellungs- und Entwicklungszyklen von Monaten auf weniger als eine Woche.

Bereitstellung fortschrittlicher Datenaufnahme-Workflows für Entwickler humanoider Roboter.

Das Training der grundlegenden Modelle hinter humanoiden Robotern erfordert riesige Datenmengen. Eine Möglichkeit, menschliche Demonstrationsdaten zu erhalten, ist die Fernoperation, aber diese Methode wird zunehmend teuer und zeitaufwändig.

Durch die Präsentation des NVIDIA KI- und Omniverse-Fernbetriebsreferenz-Workflows auf der SIGGRAPH-Computergrafikkonferenz können Forscher und KI-Entwickler große Mengen synthetischer Bewegungs- und Wahrnehmungsdaten aus einer minimalen Menge fernaufgezeichneter menschlicher Demonstrationen generieren.

Zunächst erfassen Entwickler eine kleine Menge an Fern-Demonstrationen mit Apple Vision Pro. Dann simulieren sie Aufzeichnungen in NVIDIA Isaac Sim und verwenden den MimicGen NIM-Microservice, um synthetische Datensätze aus den Aufzeichnungen zu generieren.

Entwickler verwenden sowohl reale als auch synthetische Daten, um das grundlegende Modell des humanoiden Roboters von Projekt GR00T zu trainieren, was erhebliche Zeit und Kosten spart. Anschließend verwenden sie den Robocasa NIM-Microservice in Isaac Lab, einem Robotik-Lernframework, um Erfahrungen für das Retraining des Roboter-Modells zu generieren. Während des gesamten Workflows weist NVIDIA OSMO die Rechenaufgaben nahtlos verschiedenen Ressourcen zu, wodurch die Managementlast der Entwickler um Wochen reduziert wird.

Zugang zu NVIDIA-Technologien für Entwickler humanoider Roboter erweitern.

NVIDIA bietet drei Rechenplattformen an, um die Entwicklung humanoider Roboter zu vereinfachen: den NVIDIA AI-Supercomputer zum Trainieren von Modellen; NVIDIA Isaac Sim, das auf Omniverse basiert, damit Roboter in einer simulierten Welt lernen und Fähigkeiten verfeinern können; und den NVIDIA Jetson Thor-Humanoiden Robotercomputer zum Ausführen von Modellen. Entwickler können auf alle oder Teile dieser Plattformen gemäß ihren spezifischen Bedürfnissen zugreifen und sie nutzen.

Durch das neue NVIDIA Humanoid Robot Developer Program können Entwickler frühzeitig auf neue Produkte und die neuesten Versionen von NVIDIA Isaac Sim, NVIDIA Isaac Lab, Jetson Thor und dem grundlegenden humanoiden Roboter-Modell von Projekt GR00T zugreifen.

1x, Boston Dynamics, ByteDance, Field AI, Figure, Fourier, Galbot, LimX Dynamics, Mentee, Neura Robotics, RobotEra und Skild AI gehören zu den ersten Unternehmen, die dem Early Access-Programm beigetreten sind.

Entwickler können jetzt dem NVIDIA Humanoid Robot Developer Program beitreten, um auf NVIDIA OSMO und Isaac Lab zuzugreifen und bald Zugriff auf NVIDIA NIM-Microservices zu erhalten.

Blog-Link: https://nvidianews.nvidia.com/news/nvidia-accelerates-worldwide-humanoid-robotics-development

Folgen Sie WriteGo, um die neuesten KI-Informationen zu erhalten

Share this article

Related Posts

p>Der neue Trend des KI-Schreibens revolutioniert tatsächlich unsere Herangehensweise an Schreibaufgaben und macht den Prozess erheblich einfacher und effizienter. Mit Tools wie dem KI-Aufsatzschreiber von WriteGo können Einzelpersonen die Kraft der künstlichen Intelligenz nutzen, um qualitativ hochwertige Essays, Forschungsarbeiten und Artikel mit minimalem Aufwand zu erstellen. Diese Innovation geht nicht nur darum, den Schreibprozess zu vereinfachen; es geht darum, die Qualität der Ergebnisse

der_faab3 auto-hide-last-sibling-br">Einführung: Die KI-Schreibrevolution